ゲーム音楽とMIDI

✅ MIDIが昔ゲームで使われていた背景

- MIDIは「音そのもの(波形)」ではなく、「演奏(どの音をいつ出すか・どの楽器で演奏するか)」を記録するフォーマットです。 ウィキペディア+2doomworld.com+2

- より具体的には、ゲームのBGMや効果音が比較的軽量に済むよう、「MIDI+音源(シンセサイザー/サウンドモジュール)」という構成が使われてきました。

- 特にPCゲームやDOS時代、CD-ROMが主流になる以前は、ストレージ・メモリ/音声再生能力の制限があったため、MIDIは軽量な音楽方式としてメリットがありました。 vogons.org+1

❌ MIDIが最近のゲームであまり使われなくなった理由

以下が主な理由です:

- 録音されたオーディオ(PCM/ストリーミング音声)の品質・容量コストが下がった

→ 昔は「演奏データ+音源」で済ましたが、今は「録音された音楽トラック(オーケストラ/ライブ演奏)+高ビットレート音声データ」が技術的に可能/安価になったため、MIDI方式の “シンセ演奏っぽさ” が相対的に見劣りするようになっています。

→ 実際「CD-ROM時代になり、MIDIの利点(低データ量)が薄れた」という議論があります。 vogons.org+1 - 音源の再生環境にばらつきがある/制御が難しい

→ MIDIの場合「どの楽器音源/どの音色セット(サウンドバンク)」を使うかで音質・演奏感が大きく変わります。ゲーム機・PC・サウンドカードごとに異なる音源が使われていると、ユーザー体験が揃いません。

→ 最近はゲーム開発者側が「何を再生しても同じ音で出る」ことを重視するため、録音された音をそのまま流す方式が好まれています。 - 制作ワークフロー/サウンドデザインの変化

→ ゲーム音楽・サウンドデザインは「DAW(Digital Audio Workstation)で録音/ミックス/マスタリング」→「ゲームに組み込む」という流れが強くなっています。MIDI形式だけで終わらせるには限界が出てきています。

→ また、音楽が映画・ドラマクラスのクオリティを求められるようになったことも影響しています。 - プラットフォーム・音声再生技術の進化

→ ハードウェア/ソフトウェアともに「ストリーミング音声」「マルチチャンネル(5.1ch/7.1ch/立体音響)」「高サンプリングレート」「圧縮音声」などが使えるようになってきたため、MIDIのみでは対応しづらい部分があります。

→ 例えば、環境音・ボイス・音楽が一体化して動的に切り替わるようなゲームでは、単純なMIDIではなく「音声トラック+リアルタイム音響処理」のほうが運用が楽になります。

🧐 例外・補足

- ただし、MIDIが完全に無くなったわけではありません。例えばリズムゲームや音楽ゲームの内部データフォーマットとして「演奏データ(MIDI相当)」を使い、そこに録音音源を組み合わせるというケースもあります。 Sonic Bloom

- また、MIDIが「音楽データそのもの」ではなく「演奏コントロールデータ」として有用な場面も残っています。

- さらに、規模の小さいインディーゲームやレトロ風のゲームでは、あえてMIDIやモジュール音源(昔のスタイル)を使うことで「雰囲気」を出す選択もあります。

じゃぁ、MIDIはどんな風に減っていった?

📌 例1:PCゲームでのMIDIの利用と減少

- PC用ゲームでは、1980~90年代にサウンドカード(例:Roland MT-32/SC-55等)と組み合わせて、MIDI演奏+音源という方式が普通でした。 The MIDI Music Adventure Show!+1

- たとえば、1990年代後半~2000年代初頭になると、ハードディスク容量や音声再生能力が向上し、録音されたPCM音源(WAV/MP3)をそのまま使う方式が普及し始めます。 スウィートウォーター+1

- そのため「MIDI形式で作曲・演奏・再生」していたゲーム音楽が、徐々に「録音されたトラックをストリーミング再生」する形に移行しました。

📌 例2:家庭用ゲーム機/コンソールでの状況

- コンソールゲーム(例:プレステ/Xbox世代)では、開発者が「再生される音が必ず同じように聞こえる」ことを重要視するようになりました。

- そのため、MIDI+ユーザー音源依存という方式ではなく、定められたサウンドバンク/録音済み素材を使う方式にシフトしました。

- さらに、オーケストラ録音やライブ演奏を音トラック化して使うケース(例えば ゼルダの伝説 スカイウォードソード のサウンドトラックでオーケストラ録音を取り入れた話)も出てきています。 WIRED

📌 例3:具体的な転換点・傾向

- 開発・制作側が「本物の楽器を録音」できる資源(予算・技術)が整ってきた 2000年代中盤〜後半 が、MIDI利用から録音トラックへの移行の大きな分岐点と見なせます。

- たとえば記事に「1986年頃から、作曲者はMIDIプログラミングに頼らず、リアルタイムで演奏・録音できるようになった」と書かれています。 スウィートウォーター

ゲームそのもので見てみよう

🎮 タイトル例:MIDIから録音音源への移行事例

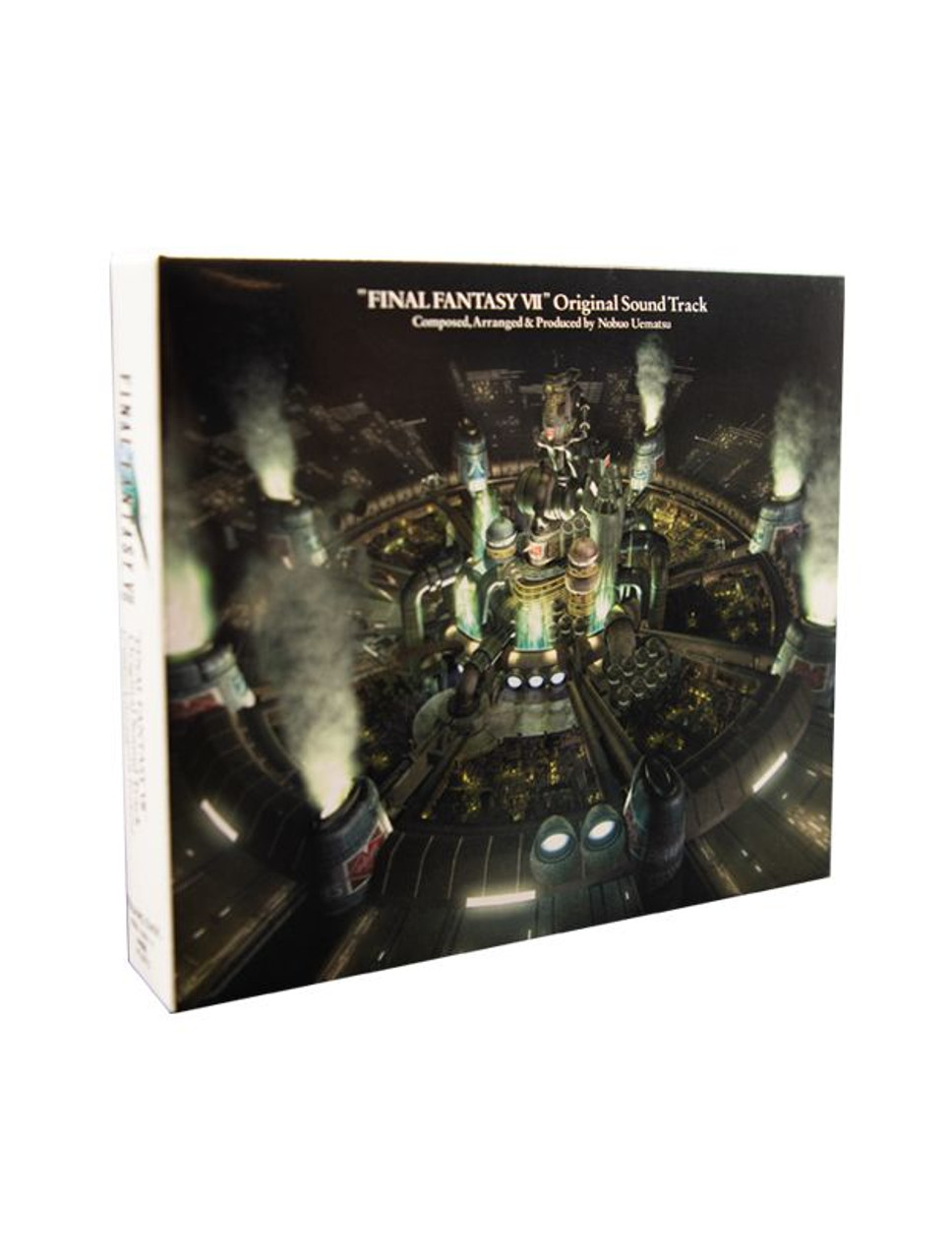

【1】Final Fantasy VII(PS1/1997)

- 開発:Square (現スクウェア・エニックス)

- 音楽:植松伸夫

- 音楽フォーマットの特徴:

この作品ではリアル録音音源ではなく、**サンプリング音源+演奏データ(MIDI的/シークエンス的)**を使用していました。“The media capabilities of the console allowed for pre-recorded Linear PCM … but it was decided to generate the music in real time on the console instead, using samples and note data.”

— Wikipedia: Music of Final Fantasy VII - 解説:音楽ファイル(WAV/MP3)を直接流すストリーミング方式ではなく、演奏情報で音源をリアルタイム再生する方式。容量節約とハードの制約に対応した代表例。

【2】Unreal(PC/1998)

- 開発:Epic Games / Digital Extremes

- 音楽フォーマットの特徴:

「モジュール音楽(tracker形式)+PCMサンプルの組み合わせ」で構成。MIDIではないが、演奏データ+音源サンプルという仕組みは近い。“Module music … used stored PCM sound samples of musical instruments sequenced together to produce music.”

— Wikipedia: Unreal (1998 video game) - 解説:MIDIと同様にディスク容量を抑えつつ音楽を生成する方式。録音済み音声ではない「中間世代」のフォーマットであり、ストリーミング音源時代への橋渡しとなった。

📊 移行の潮流まとめ

- 1990年代前半〜中期:MIDI/演奏データ+音源(サンプリング)方式が主流。 Gearspace+1

- 1999〜2002年あたり:録音音源(スタジオ録音/オーケストラ/チャントなど)をゲーム音楽に本格導入した作品が増加。

- 2000年代中盤以降:ほぼすべてのAAAゲームが録音音声ベースを採用、「MIDI形式」はインディー/レトロ風など特殊用途に限定されるようになりました。

時期 | 主流フォーマット | 備考 |

|---|---|---|

~1990年代中期 | MIDI/FM音源/サンプラー再生 | 容量制約重視。リアルタイム演奏方式。 |

1990年代後半 | モジュール音楽(tracker) | PCMサンプルと演奏データの併用。 |

2000年代以降 | 録音済み音声(WAV/MP3/OGG) | ストレージ容量拡大によりストリーミング方式が主流に。 |

💬 補足

MIDIの「演奏データ+音源依存」の仕組みは、容量削減という面では優秀でしたが、再生環境ごとに音が変わる問題がありました。

ハード性能が上がり録音音源をそのまま扱えるようになったことで、開発者が意図した音を確実に再生できる録音方式(PCM/圧縮音声)が標準となっていきました。

ゲーム別と年代で見たまとめ

🎼 ゲーム音楽フォーマットの変遷(1990〜2000年代)

年代 | 主なハード/時代区分 | 主な使用フォーマット | 主なタイトル例 | 録音音源への移行状況 |

|---|---|---|---|---|

1990〜1993 | SFC/メガドライブ/PC-98 | FM音源・PCM少量・MIDI相当データ | 『ファイナルファンタジーIV』(1991)、『ソニック・ザ・ヘッジホッグ』(1991) | 🎵 MIDI的演奏データが中心 。音はチップ音源によるリアルタイム合成。 |

1994〜1996 | PS1登場前夜、PCのサウンドカード普及期 | MIDI/モジュール(MOD)音楽 | 『DOOM』(1993, PC)、『Quake』(1996) | 🧩 MIDIまたはTracker形式が主流。音源依存あり。 |

1997〜1999 | PS1/N64/初代PC 3D世代 | MIDI+サンプル音源(ADPCM) → 一部 録音音源併用 | 『Final Fantasy VII』(1997)、『ゼルダの伝説 時のオカリナ』(1998)、『Unreal』(1998) | ⚙️ MIDI+PCMハイブリッド期 。容量節約目的で演奏データ多用。 |

1999〜2002 | PS2/Dreamcast/初代Xbox/Windows XP世代 | WAV/MP3/ADPCM録音音声が主流に | 『Final Fantasy VIII』(1999)、『Halo: Combat Evolved』(2001)、『Devil May Cry』(2001) | ✅ 完全録音音源時代の幕開け 。スタジオ録音・生演奏が一般化。 |

2003〜2006 | PS2後期/Xbox360黎明期 | ストリーミング音声(WAV/OGG/MP3) | 『Halo 2』(2004)、『FFX-2』(2003)、『メタルギアソリッド3』(2004) | 🎧 MIDIは事実上消滅 。ゲーム音楽=録音トラックが標準化。 |

2007〜2010 | Xbox360/PS3/Wii | マルチチャンネル音声(5.1ch/7.1ch)・圧縮音声 | 『Skyrim』(2011前後)、『FFXIII』(2009) | 🎬 映画並みのオーケストラ録音。サラウンドミックス時代へ。 |

2011〜2015 | スマホ黎明期/Unity普及 | AAC/MP3/OGG (圧縮音声) | 『パズドラ』(2012)、『モンスト』(2013) | 📱 モバイルでは軽量圧縮音声を採用。MIDI再生は非対応。 |

2016〜現在 | PS4〜PS5/Switch/PC | 高音質WAV/FLAC/リアルタイムミキシング | 『ゼルダの伝説 ブレス オブ ザ ワイルド』(2017)、『FFVII Remake』(2020) | 🌍 完全に録音音声ベース 。MIDIは内部制御用途に限定。 |

🎧 総括:MIDIが消えたタイミング

要素 | 消滅/移行時期 | コメント |

|---|---|---|

ゲーム内BGMをMIDIで直接再生 | 2000年前後にほぼ消滅 | PS2/Xbox初期世代では録音音声が標準化。 |

シーケンス(演奏データ)形式(MOD/XMなど) | 2002〜2005年頃まで生き残り | 一部インディーや携帯機で継続(GBA等)。 |

MIDIを内部的制御データとして使用 | 今も一部で継続 | リズムゲームや音ゲーの「譜面」制御として利用。 |

録音音声(PCM/MP3/OGG) | 2000年以降は完全主流 | 以後すべてのAAAタイトルで録音音源使用。 |

💬 解説

- 技術的背景:CD-ROM→DVD→Blu-rayとメディア容量が爆発的に増えたことで、もはや「軽量なMIDIデータ」で節約する必要がなくなりました。

- 制作ワークフロー:DAW(Cubase, Logic, ProToolsなど)で録音→ミックス→マスタリング→ゲーム実装、という映画音楽と同様の流れに統一。

- 残存用途:MIDIは“音楽”ではなく“演奏制御(リズム・同期・譜面)”としてのみ利用。例:シアトリズムFF、音ゲー系アプリ。

現代のBGMとゲーム制作:ミドルウェアの台頭

🎮 ゲームサウンドミドルウェアとは?

サウンドミドルウェアとは、ゲーム内で音楽や効果音、環境音などを効率よく管理・再生・制御するための中間層ソフトウェアです。

かつては開発者が直接プログラムで音声API(DirectSoundやOpenALなど)を操作していましたが、音量調整や3D定位、ループ制御などを個別に実装するのは非常に手間がかかりました。

ミドルウェアは、これらの処理をGUIベースで視覚的に設定できるようにし、

さらにBGMのブレンド(Adaptive Music)や環境音のリアルタイムミキシング、イベントドリブンなサウンド再生を実現します。

代表的なミドルウェアには、CRIWARE(ADX2), FMOD, Wwise があり、いずれもUnityやUnreal Engineなどの主要ゲームエンジンに統合されています。

🎧 2000年代以降の録音方式とミドルウェアの関係

時期 | 主な音声フォーマット | 特徴 | 採用ミドルウェア/エンジン | 解説 |

|---|---|---|---|---|

2000〜2005 | WAV(PCM) | 非圧縮・高音質・容量大 | 独自実装(DirectSound, XAudio) | PS2/Xbox時代は「録音音源+DirectX API」直呼び。容量との戦い。 |

2005〜2010 | MP3/OGG(圧縮音声) | 高圧縮・音質維持・CPU負荷低 | FMOD 、 CRI Middleware (ADX) | ストリーミング再生が一般化。音楽・SE・ボイスを同時再生可能に。 |

2010〜2015 | OGG/AAC/WAV(ミックス) | スマホ普及期。メモリ効率と音質のバランス重視 | CRIWARE ADX2 、 FMOD Studio 、 Wwise | サウンドイベント制御・3D定位・リアルタイムミキシングが可能に。 |

2016〜現在 | FLAC/WAV/HCA/OPUS | ハイレゾ音源・低遅延・可逆圧縮 | CRIWARE 、 Wwise 、 Unreal/Unity内蔵Audio | シネマティック音響、環境音ミキシング、RTPC制御などが標準化。 |

🧩 主なサウンドミドルウェア解説

🎛️ ① CRIWARE(ADX2 / HCA)

- 開発元:CRI・ミドルウェア(日本)

- 代表作:『モンスターハンターシリーズ』『ペルソナ5』『FFXV(日本版音声)』など

- 特徴:

- 独自コーデック HCA/HCA-MX による高圧縮・高音質(MP3より低負荷)

- サウンドキューシステム(キューシート単位で管理)

- ゲーム機・スマホ・アーケードすべて対応

- 教育的ポイント:

- “ADX2 Authoring Tool”でイベントドリブンなサウンド設計(ループ、クロスフェード、SE管理)をGUIで行える。

- Unity/Unreal統合が容易。国産タイトルに最も多い。

🎚️ ② FMOD(Firelight Technologies, オーストラリア)

- 代表作:『Resident Evil 4 Remake』『Celeste』『Forza Horizon』など

- 特徴:

- リアルタイムミキシング/DSP(Digital Signal Processing) 機能が強力。

- Adaptive Music(動的BGM) の実装が簡単。プレイヤーの状況で音楽をブレンド可能。

- OGG/WAV/MP3対応、低レイテンシ。

- 教育的ポイント:

- 無料版(非商用)でUnity・Unrealに統合可能。

- “イベント駆動型オーディオ”の教材として最適。

- 音量/フィルタ/ピッチをリアルタイム制御でき、AIや物理と連動可能。

🎚️ ③ Wwise(Audiokinetic, カナダ)

- 代表作:『God of War』『Assassin’s Creed』『Fortnite』『Genshin Impact』

- 特徴:

- RTPC(Real-Time Parameter Control) による物理連動サウンド。

- BGMや環境音をシーン条件に応じて動的ミキシング。

- HDRオーディオ(音量レンジ自動調整)など最新機能搭載。

- 教育的ポイント:

- プロ向けAAA標準。

- ゲーム開発科・サウンドコースでの「インタラクティブサウンド演習」に最適。

- Unity/Unreal連携が標準化しており、ボリューム・ピッチ・フィルタをコードレス制御可能。

🔊 補足:フォーマット別の特徴まとめ

形式 | 種別 | 主な用途 | 長所 | 短所 |

|---|---|---|---|---|

WAV | PCM | 高音質・SE・BGM素材 | 可逆・低遅延 | 容量大 |

MP3 | 圧縮(非可逆) | 一般BGM | 容量小 | ループ処理しづらい |

OGG Vorbis | 圧縮(非可逆) | BGM/SE | 高音質・ライセンス無料 | デコード負荷やや高 |

HCA(CRIWARE) | 独自圧縮 | コンソール・スマホ全般 | 高圧縮率+ループ対応 | 専用ミドルウェア必須 |

FLAC | 可逆圧縮 | ハイレゾBGM・ムービー | 高音質・保存用 | 容量大、再生負荷高 |

🧠 まとめ:ミドルウェアがもたらした変化

時代 | サウンド開発の主眼 | 代表技術 |

|---|---|---|

〜1990年代 | データ容量節約 | MIDI・ADPCM・FM音源 |

2000年代 | 高音質録音再生 | PCM/MP3/OGG |

2010年代 | 動的サウンド制御 | FMOD/ADX2/Wwise |

2020年代〜 | AI/物理連動サウンド | RTPC/DSP/Spatial Audio(3D立体音響) |

📘 教育応用のヒント:

- 授業での演習テーマ例:「FMODでプレイヤー距離に応じてBGMフェードを制御」「ADX2でループBGMとSEをキューで管理」

- Moodle課題テーマ:「CRIWARE・FMOD・Wwiseの比較レポート(機能・ライセンス・使用例)」

- 発展課題:「3Dサウンド空間をFMODまたはWwiseで設計する」

No Comments